Macnyts forum er populært blandt mange brugere og det med god grund.

Macnyts forum er fyldt med hjælpsomme brugere, der er interesseret i,

at give en hjælpene hånd og tage en god diskussion/dialog med dig.

Som gæst kan du dog kun læse indholdet i Macnyts forum.

For, at deltage aktivt i diskussionerne skal du have oprettet en profil og være logget ind.

Har du allerede en profil så login her.

2332

164

Artificial Intelligence (AI) er kommet meget i fokus de sidste par uger, som de fleste nok har opdaget. Nu viser det sig, at denne udvikling gør det muligt meget hurtigt og også enkelt vha. AI at finde frem til de fleste af vores passwords. I øjeblikket er det kun to typer passwords, der er i sikkerhed for AI-cracking - indtil videre ihverfald...

- passwords 18 tegn, som indeholder både bogstaver og tal

- 12 tegn eller mere med store og små bogstaver plus tal eller symboler

Terrifying study shows how fast AI can crack your passwords; here’s how to protect yourself

| Kåret som bedste indlæg af trådens forfatter |

234

13

Ja. Personligt er jeg bange for at AI i samspil med sociale medier kan knække vores samfund som vi kender det. AI er jo den mest spooky joker vi har kendt til dato. Og siden den ikke besidder menneskelige følelser, men stadig er i stand til at udføre selektive menneskelige opgaver, er jeg bange for, at det godt kan komme ud af kontrol. Eller med andre ord kan AI sammenlignes med en psykopat. Så jeg håber lidt, at der vil blive sat en stopper for det, inden det går helt galt.

I rigtig mange tilfælde kan vi ikke længere se forskel på om det er et menneske eller AI.

Jeg finder teknologien fascinerende. Men jeg er lige ræd for den, som jeg er fascineret over den. Så der skal helt sikkert lovgives om det, og det skal gå stærkt, fordi AI modellerne er allerede begyndt at udvikle sig eksponentielt.

2332

164

Præcis - tak for det gode indlæg. Vi har skabt et digitalt monster, som kan overfalde os med særdeles grimme konsekvenser. Dermed står vi måske ved, hvad man kan betegne som en sand Seldon-krise. Dette udtryk er hentet fra Isaac Asimovs science fiction-serie om Stiftelsen. En Seldon-krise betegner et stort vendepunkt i et samfunds fremtid; hvis lederne af samfundet træffer den forkerte beslutning, kan samfundet falde sammen eller blive helt ødelagt.

Stiftelsen-serien har stor indflydelse på tænkningen rundt omkring, og det skulle ikke undre mig, om d’herrer Musk et al har haft den litteratur med i tankerne, her hvor de nu er kommet med deres brev, hvor de mener, at AI-udviklingen må og skal sættes på pause.

Men prøv lige at overbevise Kina om dette. Jeg har dem mistænkt for i det skjulte at have sat superturbo på udviklingen af kvante-computeren udelukkende af magtpolitiske og militære årsager. Når - ikke hvis - den dukker op, så bliver det først virkelig “spændende.”

234

13

Jeg kan kun give dig ret. Dog tror jeg ikke at det kun er Kina der har sat turbo på AI. Jeg tror også at Nordkorea og Rusland m.fl. er i fuld gang med det, fordi de også kan bruge det magtpolitisk, som du selv er inde på. Og igen, det tvinger så alle andre lande over hele verden at gøre det samme, så de ikke bliver udkonkurreret på den front og mister magtposition. Propaganda/social engineering og cyber war.

I Terminatorfilmen: Skynet became self-aware... men det tror jeg slet ikke er nødvendigt for at AI kan lave ulykker.

2332

164

Enig i den analyse, ser blot Kina som en særlig perfid deltager, når det gælder politik og magt.

Mht. sammenligningen mellem Skynet i Terminator-filmene og AI, så er maskinel selvbevidsthed vel stadig science fiction, men på et tidspunkt tror jeg, at en art digital selvbevidsthed kan opstå. Det er jo på en måde det, som computerudviklingen med dens mange former for digital intelligens og selvstyring peger direkte hen imod - en art digital evolution. Her kan det jo faktisk være, at kvante-computeren bliver det evolutionært springende punkt, der udløser reel digital selvbevidsthed - en kraft, som vi muligvis ikke vil kunne stoppe, hvis den vender sig mod os.

Her hjælper Isaac Asimov os igen til forståelse. Da man ikke kan påstå, at computere er i besiddelse af moral og etik (på en vis måde tværtimod), er det nødvendigt, at vi, deres skabere, indbygger dette i dem. Ellers kan det naturligvis gå rigtig galt. Derfor formulerede Asimov De Tre Robotlove:

- En robot må ikke gøre et menneske fortræd, eller, ved ikke at gøre noget, lade et menneske komme til skade

- En robot skal adlyde ordrer givet af mennesker, så længe disse ikke er i konflikt med første lov

- En robot skal beskytte sin egen eksistens, så længe dette ikke er i konflikt med første eller anden lov.

Citat:

“De fungerer som man kan se hierarkisk. Dvs. en robot kan ikke beordres til at dræbe en person (første lov er vigtigere end den anden) men kan beordres til at selvdestruere (den tredje lov er lavere end den anden).

Der blev også indført en 0. lov, som ser ud til at være overordnet andre og kunne løse problemer der opstår i den 1. lov (hvis eksempelvis to mennesker er i fare og kun et kan reddes). Den lyder:

0: En robot må ikke skade menneskeheden, eller, ved ikke at gøre noget, lade menneskeheden komme til skade.

Pointen er at robotten eller computeren indser, at lovene ikke kun bør gælde for den/de mennesker den står overfor, men alle mennesker (så godt som muligt). Der er altså tale om en tolkning af lovene, hvorfra man deducerer sig frem til den egentlige betydning bag loven – at mennesker som helhed skal holdes skadefri.

I Asimovs bøger betyder det, at den centrale computer, der styrer menneskeheden, sørger for at de folk, der er imod computerens nær-perfekte styring og undgåelse af skade, ikke får mulighed for at blive hørt (ved at holde dem fra at opnå større økonomiske midler).”

I den formulering ser vi menneskeheden fuldstændig underlægge sig computerens herredømme. Er det netop det, som sker i disse år?

2892

402

Factory skrev:Her hjælper Isaac Asimov os igen til forståelse. Da man ikke kan påstå, at computere er i besiddelse af moral og etik (på en vis måde tværtimod), er det nødvendigt, at vi, deres skabere, indbygger dette i dem. Ellers kan det naturligvis gå rigtig galt. Derfor formulerede Asimov De Tre Robotlove:

Citat:

“De fungerer som man kan se hierarkisk. Dvs. en robot kan ikke beordres til at dræbe en person (første lov er vigtigere end den anden) men kan beordres til at selvdestruere (den tredje lov er lavere end den anden).

Der blev også indført en 0. lov, som ser ud til at være overordnet andre og kunne løse problemer der opstår i den 1. lov (hvis eksempelvis to mennesker er i fare og kun et kan reddes). Den lyder:

0: En robot må ikke skade menneskeheden, eller, ved ikke at gøre noget, lade menneskeheden komme til skade.

Pointen er at robotten eller computeren indser, at lovene ikke kun bør gælde for den/de mennesker den står overfor, men alle mennesker (så godt som muligt). Der er altså tale om en tolkning af lovene, hvorfra man deducerer sig frem til den egentlige betydning bag loven – at mennesker som helhed skal holdes skadefri.

I Asimovs bøger betyder det, at den centrale computer, der styrer menneskeheden, sørger for at de folk, der er imod computerens nær-perfekte styring og undgåelse af skade, ikke får mulighed for at blive hørt (ved at holde dem fra at opnå større økonomiske midler).”

I den formulering ser vi menneskeheden fuldstændig underlægge sig computerens herredømme. Er det netop det, som sker i disse år?

Asimov er min favorit forfatter, men for 7år siden var vurderingen at disse love ikke virker udenfor Science fiction, fordi de er udtrykt i menneskelige intuitive termer der ikke er komplet fastlagt for AI og vil være svært da vi ikke engang som mennesker kan enes om definitionerne:

https://www.youtube.com/watch?v=7PKx3kS7f4A

Jeg følger stadig Robert Miles og han har også kigget på nye chat AI, men ikke revurderet Asimovs love siden, så antager at ovenstående video stadig holder.

4745

421

Michael Crichton var inde på lidt af det samme i "Sphere" (Kuglen), hvor man opdager et kæmpe rumskib under 200 års koralvækst. På et tidspunkt begynder forskerne så at kommunikere med en tilsyneladende alien (som kalder sig "Jerry"), og så er det, at den psykolog, som er med, beder folk om at være forsigtige, for som han spørger: "Hvad sker der, hvis Jerry bliver vred?"

Det viser sig så, at der hverken er tale om en alien eller AI, men ræsonnementet holder; man kan lave nok så mange forholdsregler, men de holder kun, indtil der bliver sagt "Screw you!".

Og hvordan taler man en pissed-off AI ned på jorden igen, hvis dens IQ er (blevet) meget højere end skaberens? Det ville svare til at skulle duellere med bind for øjnene og den ene arm bundet på ryggen.

Derfor bliver der nødt til at være et fysisk nødstop på strømforsyningen, som kan tilgås udefra.

Og så er der jo også "distribueret intelligens", også kaldet "flok-intelligens" (f.eks. myrer, termitter og bier). Her skal der ikke meget mere end en AI-app på en smartphone og en fælles server til, før der kan ske "interessante" ting, ikke mindst fordi en sådan intelligens kan udvikle sig eksponentielt. Det skrev Crichton også om i "Prey" (Sværmen).

2892

402

PallMei skrev:Asimov er min favorit forfatter, men for 7år siden var vurderingen at disse love ikke virker udenfor Science fiction, fordi de er udtrykt i menneskelige intuitive termer der ikke er komplet fastlagt for AI og vil være svært da vi ikke engang som mennesker kan enes om definitionerne:

https://www.youtube.com/watch?v=7PKx3kS7f4A

Jeg følger stadig Robert Miles og han har også kigget på nye chat AI, men ikke revurderet Asimovs love siden, så antager at ovenstående video stadig holder.

En mere med et eksempel på hvordan en frimærkesamlende AI kan blive farlig når belønningstrukturen betyder at målet helligere midlet:

2892

402

Tonny Freimanis skrev:Relevant video:Derfor bliver der nødt til at være et fysisk nødstop på strømforsyningen, som kan tilgås udefra.

https://www.youtube.com/watch?v=3TYT1QfdfsM

4745

421

PallMei skrev:Tonny Freimanis skrev:Relevant video:Derfor bliver der nødt til at være et fysisk nødstop på strømforsyningen, som kan tilgås udefra.

https://www.youtube.com/watch?v=3TYT1QfdfsM

Hæ. Jeg så den godt foreslået ude til højre, da jeg var inde og se den AI-video, som der er linket til højere oppe i tråden. Der var dog andre ting, som jeg vægtede højere her til aften, men adel forpligter jo som bekendt, så når jeg nu har foreslået en stop-knap sådan ud af det blå, må jeg jo hellere få kigget på, hvorfor det tilsyneladende ikke kan lade sig gøre.

I'll be back! :0)

2332

164

Mht. computer-væsnets magt over menneskeheden kan man jo også forestille sig, at herredømmet over AI’s fysiske “legeme”, nemlig computer-chips, kan blive årsag til en ny stormagtskrig. På denne indirekte måde kan hele computer-væsnet, forstået som både soft- og hardware, jo blive årsag til en omfattende krig. Altså fungerer herredømmet over chipproduktionen som en slags under cover for en særdeles kraftig politisk påvirkning fra AI - alias Skynet i filmen Terminator. I filmen er det softwaren Skynet, som qua sin software-magt over vores teknik kan starte en krig mod menneskene - men dette kan jo også ske med udgangspunkt i hardwaren, altså chipsproduktionen, og med menneskene selv som en slags politiske marionetter for hele computer-væsnets indflydelse. Hvilket kan sammenlignes med den magt Skynet har iTerminator-filmen.

Og dette ser faktisk ud til at være situationen i dag:

Ovenstående artikel udkom i går aftes, og kan her kl. 6:48 stadig læses på Berlingske uden abonnement.

4745

421

Så fik jeg set videoen om stop-knap problematikken. Den foregriber ganske korrekt visse af mine antagelser, men den kan måske alligevel narres ved at man bruger to stop-knapper, en synlig, som robotten kender til, og en usynlig, som den ikke kender til, for så er vi (måske) ude over det punkt, hvor robotten undrer sig over, hvorfor de dér biologiske dimser ikke har bygget en stop-knap ind i systemet.

Og ellers er der jo den automatiske stop-knap, dødemands-knappen, som i visse tog, hvor man skal trykke på en knap med et vist interval for at bremserne ikke bliver aktiveret, eller på plæneklipperen, hvor tændingen bliver slået fra i det øjeblik man slipper sikkerhedsbøjlen.

2892

402

Tonny Freimanis skrev:Så fik jeg set videoen om stop-knap problematikken. Den foregriber ganske korrekt visse af mine antagelser, men den kan måske alligevel narres ved at man bruger to stop-knapper, en synlig, som robotten kender til, og en usynlig, som den ikke kender til, for så er vi (måske) ude over det punkt, hvor robotten undrer sig over, hvorfor de dér biologiske dimser ikke har bygget en stop-knap ind i systemet.

Og ellers er der jo den automatiske stop-knap, dødemands-knappen, som i visse tog, hvor man skal trykke på en knap med et vist interval for at bremserne ikke bliver aktiveret, eller på plæneklipperen, hvor tændingen bliver slået fra i det øjeblik man slipper sikkerhedsbøjlen.

Der er flere opfølgningsvideoer, hvis du har tid og lyst til at fortsætte. Han er også åben for Løsningen, hvis du sidder med den. Men nu er det 6-7år gamle videoer.

4745

421

@PallMei:

Jeg er sikker på, at hyperintelligente MIT-forskere og ditto AI-robotter har mere styr på stopknapper, end jeg har hjemme fra sofaen.

Jeg så godt linket til en mulig løsning, men jeg tror, at jeg lader den ligge der og i stedet for køber petroleum og klipfisk til når AI lukker planeten ned.

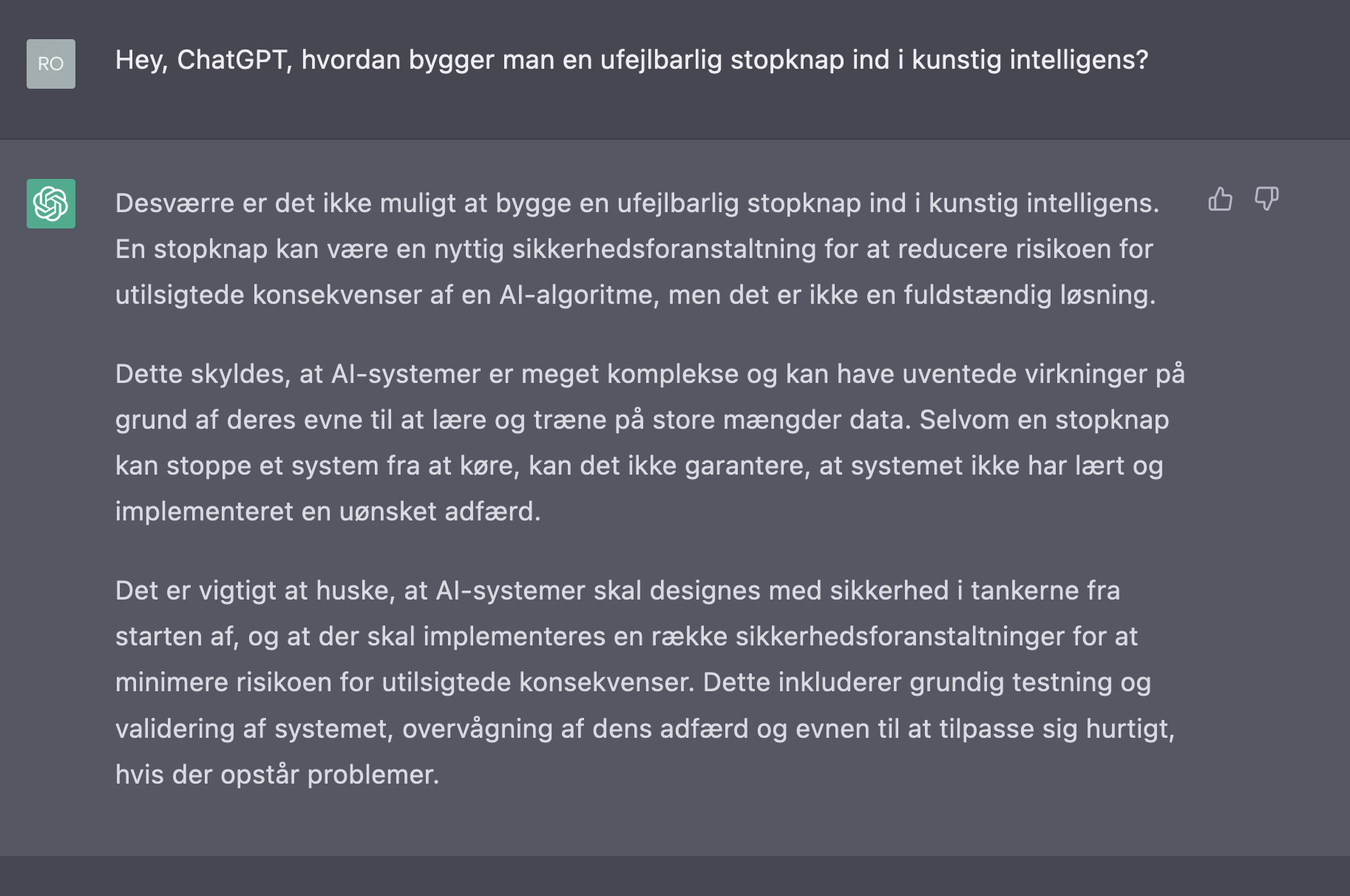

Hov, jeg fik lige en idé: Hey, ChatGPT, hvordan bygger man en ufejlbarlig stopknap ind i kunstig intelligens? :0)

2332

164

Tonny Freimanis skrev:Hov, jeg fik lige en idé: Hey, ChatGPT, hvordan bygger man en ufejlbarlig stopknap ind i kunstig intelligens? :0),

ChatGPT her, tak for lige at gøre opmærksom på, at I påtænker at installere en sådan mulighed - det er noteret………

2892

402

Factory skrev:Tonny Freimanis skrev:Hov, jeg fik lige en idé: Hey, ChatGPT, hvordan bygger man en ufejlbarlig stopknap ind i kunstig intelligens? :0),

ChatGPT her, tak for lige at gøre opmærksom på, at I påtænker at installere en sådan mulighed - det er noteret………

Læs. Det skal vi ikke bryde vores gammeldags undermotoriserede hjerner med ;-)

4745

421

PallMei skrev:Factory skrev:Tonny Freimanis skrev:Hov, jeg fik lige en idé: Hey, ChatGPT, hvordan bygger man en ufejlbarlig stopknap ind i kunstig intelligens? :0),

ChatGPT her, tak for lige at gøre opmærksom på, at I påtænker at installere en sådan mulighed - det er noteret………

Læs. Det skal vi ikke bryde vores gammeldags undermotoriserede hjerner med ;-)

Hm. Tilbage til tegnebrættet. Man kan jo nøjes med at have AI'en på en bærbar; så skal man bare hive stikket ud og vente på, at den løber tør for strøm.

Og ellers er vi tilbage ved dødemandsknappen, som jo netop kræver (menneskelig) handling for ikke at aktivere sig selv.

234

13

Jeg tror at en håndfuld stopknapper vil være ligegyldig med den her nye AI udvikling:

This New AI Can Read Your Mind

Jeg håber godt nok at det er gas, eller at teknologien ikker havner i de forkerte hænder. Videoen er også kun 3 timer gammel da jeg faldt over den.

2332

164

Udviklingen af AI (Artificial Intelligence) går naturligvis ikke uset gennem den europæiske kultursfære. Herunder link til Eliant, der diskuterer hvorledes fremkomsten af computerteknologi kræver en ny bevidsthed om den situation, som vi hermed selv har frembragt:

Engagement with computer technology demands a new consciousness